트랜스포머 다음은 무엇인가: 세 갈래 흐름과 NVIDIA의 계산

- 한눈에 보는 핵심요약

- • 트랜스포머 한계를 넘으려는 3가지 흐름(Mamba, World Model, Diffusion LLM) • 젠슨 황이 직접 AI를 만드는 진짜 이유(feat. Nemotron Coalition)

안녕하세요, 에디터 쏘입니다 :)

오늘은 최근 AI 아키텍처를 둘러싼 세 가지 흐름과, NVIDIA가 왜 그 경쟁에 직접 뛰어들고 있는지를 함께 보려고 합니다.

지난 수년간 대형 언어 모델의 표준은 사실상 트랜스포머였습니다. GPT, Claude, Gemini를 비롯한 거의 모든 주요 모델이 이 구조를 기반으로 발전해왔죠. 그런데 에이전트가 도구를 호출하고, 더 긴 문맥을 다루고, 여러 모델이 협업하는 일이 늘어나면서, 트랜스포머가 감당해야 할 계산 비용과 메모리 부담도 빠르게 커지고 있습니다.

흥미로운 건, 이 한계를 넘어서려는 시도가 하나의 방향으로 수렴하지 않는다는 점입니다. 지금 AI 업계에는 서로 다른 실험들이 동시에 벌어지고 있습니다. 트랜스포머를 보완하려는 하이브리드 구조, 언어 모델의 한계를 넘어 월드모델로 가려는 시도, 그리고 생성 방식 자체를 바꾸려는 Diffusion LLM까지. 각각의 방향은 문제의식도 다르고, 지향하는 미래도 조금씩 다릅니다.

그런데 이런 흐름을 유심히 지켜보는 곳이 있습니다. 어떤 아키텍처가 이기든, 그 모델을 훈련하고 실행하는 데는 GPU가 필요합니다. NVIDIA의 최근 움직임이 단순한 모델 발표 이상으로 읽히는 이유가 여기 있습니다. 이 글에서는 먼저 세 갈래의 흐름을 짚고, 마지막에는 NVIDIA가 왜 직접 Nemotron을 만들고 연합까지 꾸리며 이 판에 개입하는지 살펴보겠습니다.

첫 번째 갈래: Mamba와 하이브리드

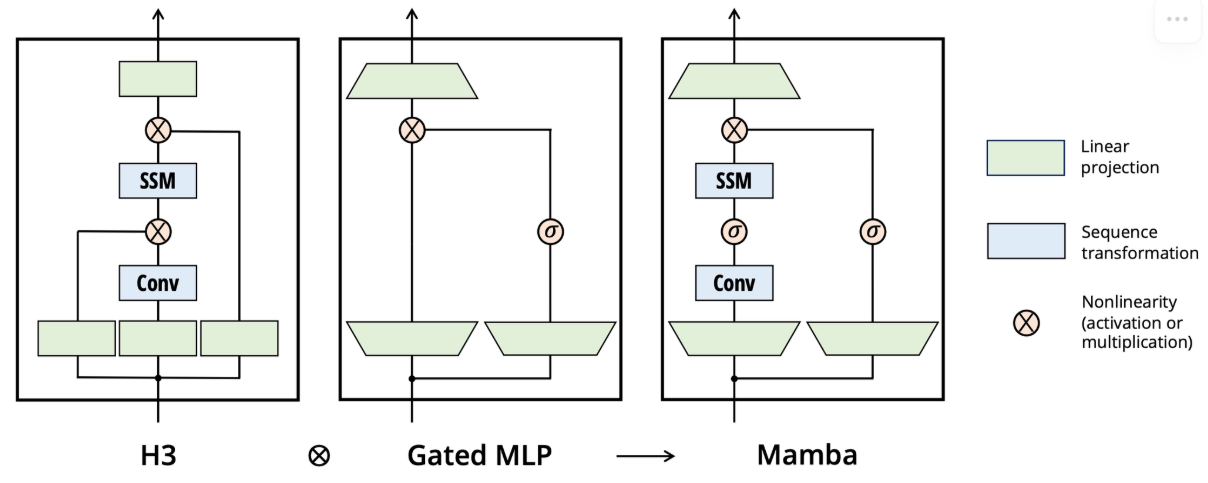

첫 번째로 먼저 현실적인 개선 방향입니다. 트랜스포머를 전면 교체하는 대신, 가장 비효율적인 부분인 어텐션 레이어의 비중을 줄이는 방식이에요. 이 진영의 대표적인 선택지가 SSM(State Space Model), 그중에서도 Mamba입니다.

Mamba는 2023년 12월 발표된 아키텍처로, SSM(State Space Model, 상태 공간 모델)에 '선택적 상태 업데이트(Selective State Space)' 메커니즘을 추가한 구조입니다. SSM은 시퀀스를 처리할 때 고정된 크기의 숨겨진 상태(hidden state) h(t)를 유지하면서 두 개의 방정식으로 동작합니다.

- 상태 방정식: h(t) = A·h(t-1) + B·x(t) — 이전 상태와 현재 입력을 받아 새로운 상태를 만듦

- 출력 방정식: y(t) = C·h(t) — 현재 상태로부터 출력을 생성

여기서 A, B, C는 학습 가능한 파라미터입니다. 트랜스포머의 어텐션이 모든 토큰을 서로 참조하는 것과 달리, SSM은 이 작은 상태 벡터 하나에 지금까지의 문맥을 압축해서 유지해요.

Mamba의 핵심은 이 파라미터들을 입력에 따라 동적으로 바꾸는 것입니다. 즉, "이 토큰은 중요하니 상태에 강하게 반영하고, 저 토큰은 덜 중요하니 흘려보내자"는 판단을 모델이 스스로 학습하게 하는 것입니다. 이를 Selective Scan이라고 부릅니다. 이전 SSM들은 A, B, C가 고정값이어서 모든 토큰을 동일하게 처리했는데, Mamba는 이 값들이 입력 x(t)의 함수로 바뀝니다.

이 덕분에 Mamba는 트랜스포머와 근본적으로 다른 성능 특성을 가집니다. 시퀀스 길이에 관계없이 상태 크기가 고정되어 있어습니다. 토큰 하나를 생성할 때마다 고정된 연산만 수행하기 때문에, 특히 긴 시퀀스 환경에서 트랜스포머 대비 최대 5배 높은 추론 처리량을 기록합니다. 병렬 학습을 위한 별도의 하드웨어 알고리즘으로 GPU에서 효율적으로 학습할 수 있습니다.

그러나 Mamba가 주목받지 못한 데에는 치명적인 단점이 있기 때문입니다. 모든 과거 정보를 고정 크기 상태에 압축하다 보니, "100번째 줄에서 정의된 변수 이름이 뭐야?"처럼 과거의 특정 위치를 정밀하게 참조해야 할 때 트랜스포머의 어텐션보다 성능이 떨어집니다. 정보를 압축해 저장하다 보니 특정 세부 정보가 희석되는 것입니다.

Transformer+Mamba 하이브리드: NVIDIA의 Nemotron 3

이 단점을 보완하기 위해 연구자들이 선택한 방향은 Mamba와 Attention을 섞는 하이브리드입니다. Mamba 레이어가 전체 레이어의 대부분을 담당해 메모리와 속도를 확보하되, 소수의 Attention 레이어를 전략적 위치에 배치해 ‘정밀 참조’가 필요한 순간에만 전체 컨텍스트를 참조하게 하는 것입니다. AI21의 Jamba, Microsoft의 Phi-4-mini-flash가 이 방향이고, 이 방향에서 주목받는 모델이 NVIDIA의 Nemotron 3입니다.

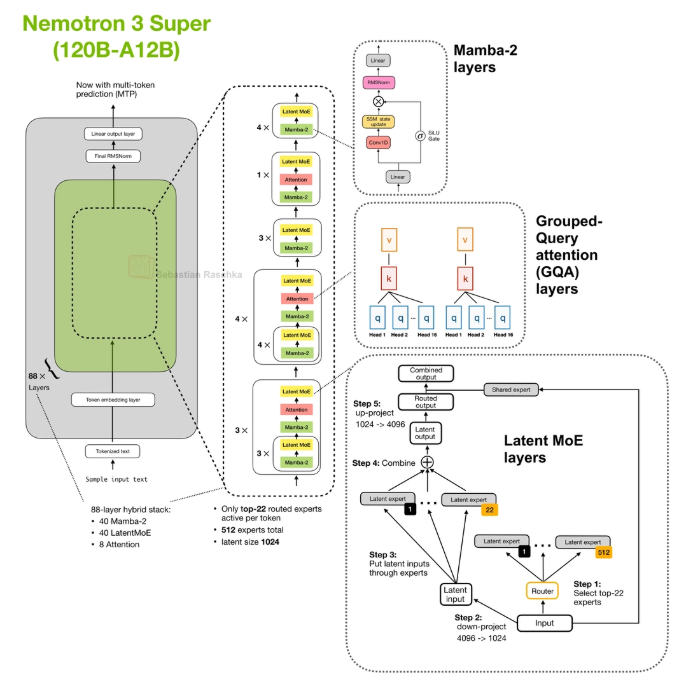

Nemotron 3 Super(120B-A12B) 아키텍처

출처: LLM Architecture Gallery(Sebastian Raschka)

① 하이브리드 Mamba-Attention 레이어 구성

Nemotron 3는 대부분의 레이어를 Mamba-2로 구성하고, 일부 Attention 레이어를 함께 배치합니다. Mamba는 시퀀스 길이에 대해 선형 복잡도로 동작하고, 생성 시에는 고정 크기 상태만 유지하기 때문에 Transformer의 KV cache처럼 메모리가 계속 증가하지 않습니다. 이 구조는 긴 컨텍스트에서의 효율을 크게 개선합니다. 결과적으로 Mamba의 효율성과 Transformer의 정밀한 참조 능력을 함께 활용할 수 있습니다.

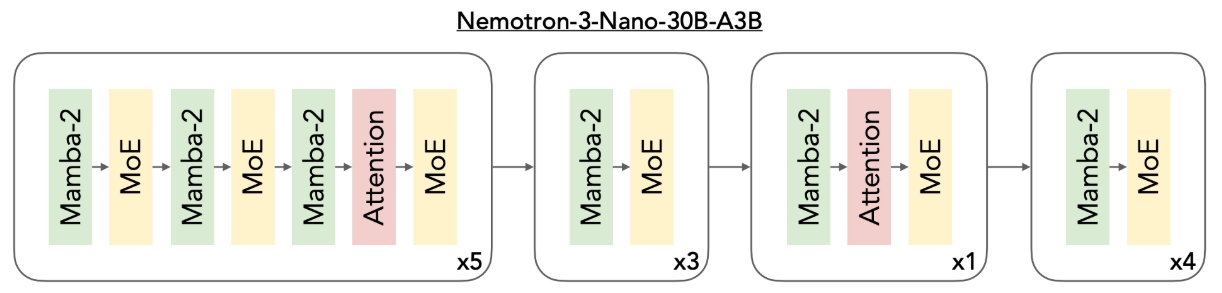

Nemotron 3 Nano의 레이어 패턴.

Mamba-2 레이어(초록색)와 MoE 레이어(노란색)가 대부분을 차지하고, 소수의 Attention 레이어(분홍색)가 전략적 위치에 배치된 구조

출처: NVIDIA, Nemotron 3 Nano Technical Report (2025)

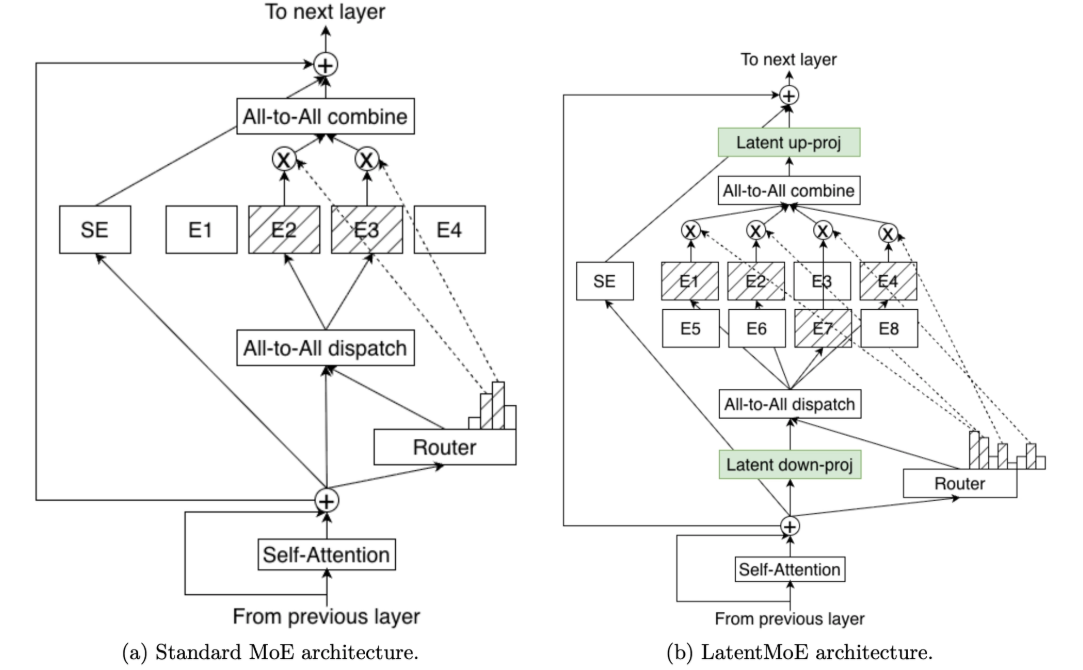

② LatentMoE: 압축 후 Expert 라우팅

MoE 구조에서는 Expert 간 토큰을 주고받는 all-to-all 통신이 큰 병목이 됩니다. Nemotron 3는 토큰을 더 작은 잠재 공간으로 먼저 압축한 뒤 Expert로 전달하는 LatentMoE를 사용해 이 문제를 해결합니다. 이 방식은 GPU 간 전송되는 데이터 양을 줄여 통신 비용을 크게 낮춥니다. 절약된 비용은 더 많은 Expert와 더 높은 Routing Capacity에 활용되며, 결과적으로 더 세밀한 분업과 성능 향상으로 이어집니다.

💡LatentMoE가 all-to-all 통신의 병목을 어떻게 줄이는가?

MoE에서 Expert들은 일반적인 다중 GPU 환경에서 여러 GPU에 분산되어 있습니다. 예를 들어 GPU 4개에 Expert가 각각 배치되어 있다고 하면, 입력 토큰들도 각 GPU에 나뉘어 들어옵니다. 그런데, 토큰 A는 GPU 1에 있는데, 라우터가 "이 토큰은 GPU 3의 Expert가 처리해야 한다"고 결정하거나, 반대로 GPU 3에 있는 토큰 B는 GPU 1의 Expert로 가야 하는 경우가 생길 수 있습니다. 이렇게 모든 GPU가 서로에게 토큰을 주고받는 과정을 all-to-all 통신이라고 합니다.

이때 통신비용은 전송하는 데이터 양, 즉 토큰 벡터의 크기 d에 비례합니다. Nemotron 3 Super과 Ultra에 적용된 LatentMoE는 이를 해결하기 위해 토큰을 Expert로 보내기 전에 더 작은 잠재 차원 ℓ로 먼저 압축합니다. 덕분에 GPU 간에 오가는 데이터 양이 줄어듭니다. d/ℓ = 4라면 대역폭 비용이 4배 감소하죠. GPU 간 통신 횟수 자체는 동일하지만, 전송되는 데이터 양이 줄어들기 때문에 특히 많은 토큰을 동시에 처리하는 환경에서 효과가 큽니다.

Standard MoE vs. LatentMoE 비교.

LatentMoE는 라우팅 전 토큰을 더 작은 잠재 공간으로 먼저 압축해 통신 비용을 d/ℓ 배 줄이고, 같은 비율로 Expert 수를 늘린다.

출처: Nemotron 3 Super Technical Report (NVIDIA, 2026)

③ Multi-Token Prediction(MTP)

Nemotron 3는 여러 토큰을 동시에 예측하는 MTP를 사용합니다. 초기 연구는 미래 토큰을 독립적으로 병렬 예측했지만, DeepSeek-V3는 이를 순차적으로 연결하는 방식으로 개선했습니다. Nemotron 3는 여기에 가중치 공유 구조를 적용해, 여러 토큰 후보를 미리 생성하는 과정을 더 효율적으로 만듭니다. MTP의 구체적인 작동 방식은 추후 더 자세히 다룰 기회가 있으면 소개하겠습니다.

④ NVFP4: 처음부터 4비트로 학습

Nemotron Super, Ultra는 사후 양자화(post-training quantization)가 아니라 처음부터 4비트 부동소수점(NVFP4)으로 학습합니다. 다만 Mamba 출력 레이어나 Attention의 QKV 프로젝션처럼 정밀도에 민감한 일부 레이어는 BF16 또는 MXFP8을 유지하는 혼합 정밀도 방식을 사용합니다. 핵심은 정확도를 크게 잃지 않으면서 더 낮은 정밀도의 메모리·연산 효율 이점을 활용하는 것입니다.

두 번째 갈래: 월드모델과 JEPA

두 번째는 훨씬 근본적인 도전입니다. 트랜스포머를 고치는 게 아니라, 텍스트 토큰 예측 자체가 AI의 올바른 방향이 아니라는 주장이에요.

월드모델(World Model)이란 AI가 세계의 작동 방식을 내부적으로 시뮬레이션할 수 있는 모델을 말합니다. 단순히 다음 단어를 예측하는 게 아니라, "이 행동을 하면 어떤 결과가 일어날까"를 예측할 수 있는 구조입니다. 아이가 공을 던지면 어디로 날아갈지 아는 것처럼, 물리적 인과관계를 이해하는 AI를 만들겠다는 방향입니다.

이 진영의 가장 뚜렷한 목소리가 얀 르쿤(Yann LeCun)입니다. 튜링상 수상자이자 딥러닝의 대부 중 한 명이죠. 지난 3월 9일, 그가 Meta를 떠나 세운 스타트업 AMI Labs가 10억 3천만 달러의 시드 투자를 유치했습니다.

르쿤이 제안하는 구체적인 아키텍처가 JEPA입니다. 기존 LLM이 "다음 토큰이 무엇인가"를 직접 예측하는 것과 달리, JEPA는 입력을 추상적인 표현으로 변환한 뒤 그 표현 공간에서 미래 상태를 예측합니다. "무슨 픽셀이 올 것인가"가 아니라 "어떤 의미 있는 상황이 올 것인가"를 예측하는 것이죠. JEPA에 대한 자세한 내용은 이전 뉴스레터 #41 얀 르쿤의 JEPA에서 확인해주세요.

같은 방향을 보고 있는 곳들도 있습니다. Fei-Fei Li의 World Labs, Google DeepMind의 Genie 3, NVIDIA의 Cosmos 플랫폼이 비슷한 맥락에 있어요.

세 번째 갈래: Diffusion LLM

세 번째는 아직 주류는 아니지만 가장 이질적인 방향으로, Diffusion LLM입니다.

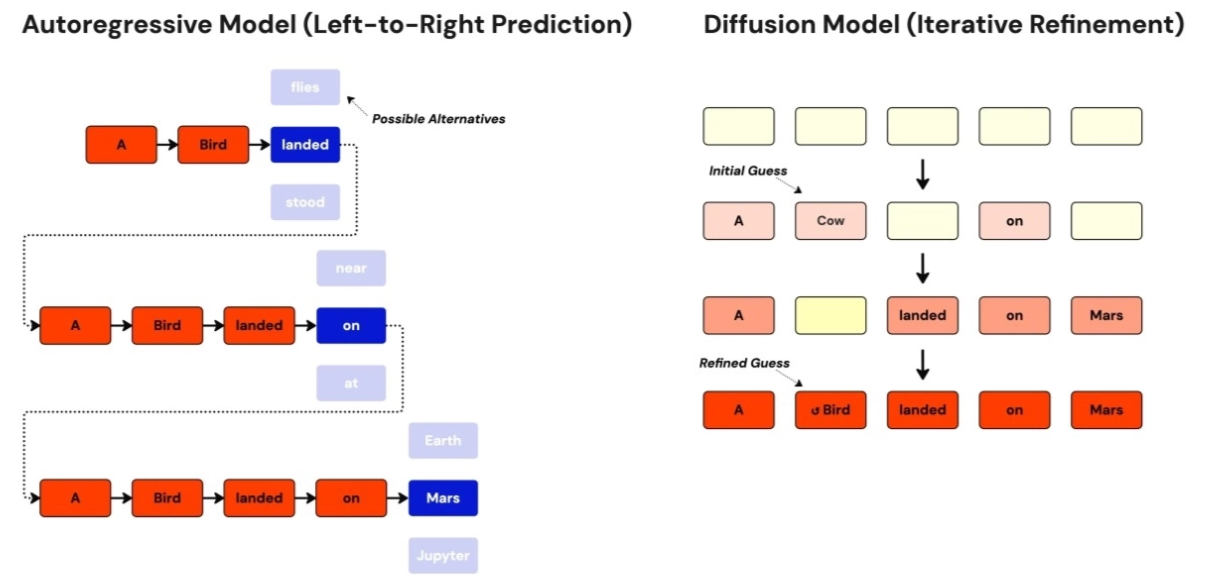

Autoregressive vs. Diffusion-Based LLMs

출처: Is Next-Token Prediction Holding LLMs Back? A New Paradigm Emerges (Nikolai Lorenz)

Diffusion LLM의 개념과 작동 원리는 이전 글에서 자세히 다뤘습니다. 핵심만 다시 짚어보면, 기존 LLM이 왼쪽에서 오른쪽으로 토큰을 하나씩 생성하는 자기회귀(Autoregressive) 방식이라면, Diffusion LLM은 전체 문장을 한 번에 놓고 점진적으로 완성해가는 방식입니다.

이미지 diffusion이 노이즈를 점점 제거하며 이미지를 복원하듯, Diffusion LLM은 마스크되거나 손상된 텍스트를 여러 단계에 걸쳐 반복적으로 복원합니다. 이 과정에서 여러 토큰을 동시에 갱신할 수 있어 병렬 생성이 가능해집니다. 덕분에 출력 속도를 크게 높일 수 있습니다.

이런 방식은 코드 생성처럼 여러 위치의 일관성을 함께 맞춰야 하는 작업에서 잠재적인 장점이 있다는 평가를 받습니다. 반면 긴 문맥에서의 안정성과 전반적인 성능은 아직 기존 LLM과 격차가 존재합니다.

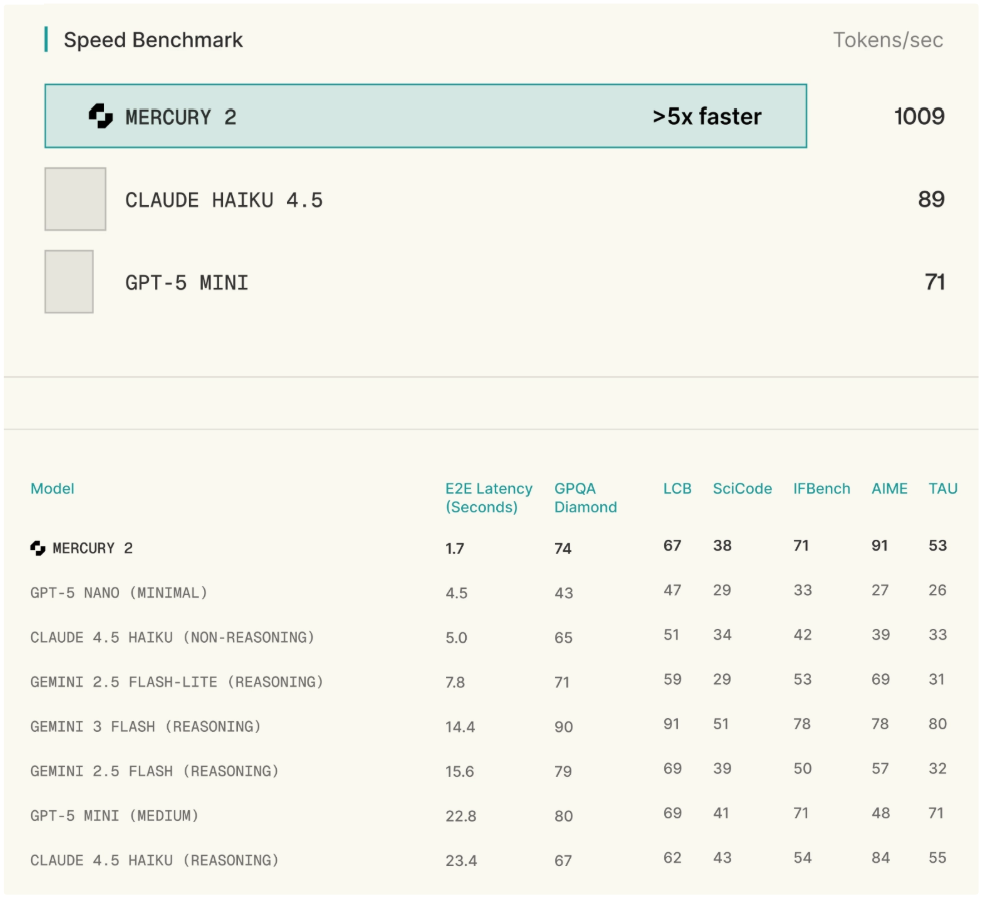

현재 대표적으로 언급되는 Diffusion LLM은 LLaDA(Large Language Diffusion Models)와 Inception Labs의 Mercury입니다. Inception Labs는 FlashAttention, DPO, Diffusion 모델 등 핵심 AI 기술에 기여한 연구진들이 세운 팀으로, 이 분야에서 특히 주목받고 있습니다.

흥미로운 점은 이들 역시 완전히 새로운 구조를 쓰는 것이 아니라, 내부적으로는 여전히 트랜스포머를 기반으로 한다는 점입니다. 다만 생성 방식이 다를 뿐입니다. 트랜스포머는 각 단계마다 어떤 토큰을 어떻게 수정할지를 판단하는 역할을 반복적으로 수행하며, 그 결과가 점차 정제된 텍스트로 수렴합니다.

세 갈래의 방향은 서로 다르지만, 공통점이 하나 있습니다. 어느 접근이 부상하든 결국 그 모델을 가장 잘 학습시키고, 가장 빠르게 서빙하고, 가장 넓게 퍼뜨릴 인프라가 필요하다는 점입니다. NVIDIA가 이 경쟁을 유심히 보는 이유도 여기에 있습니다.

NVIDIA가 오픈 모델 연합을 결성한 이유

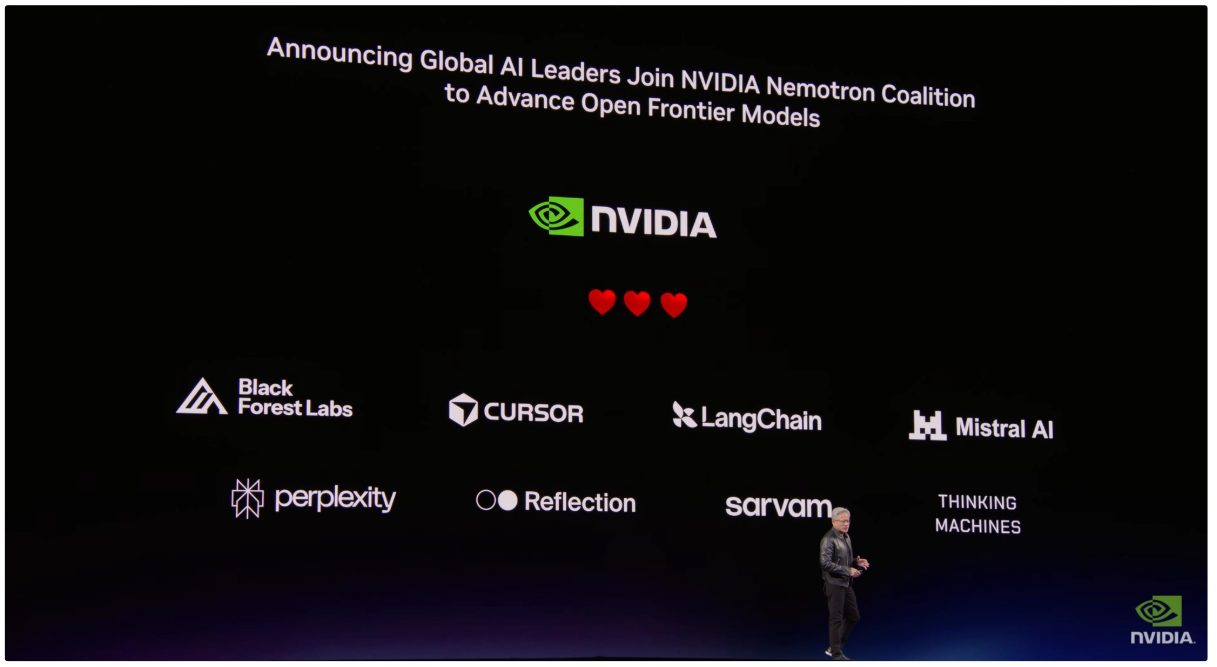

지난 3월 16일, NVIDIA의 연례 개발자 컨퍼런스 GTC 2026이 열렸습니다. NemoClaw, Vera Rubin, 로보택시 파트너십까지 볼거리가 많았지만, 저는 그중에서도 Nemotron Coalition 발표가 가장 인상깊었습니다. GPU를 만드는 회사가 왜 프론티어 오픈 모델 개발 연합을 직접 주도할까요? 이 질문을 따라가다 보면, NVIDIA가 그리는 판의 구조가 보입니다.

Nemotron Coalition 참여 기업

Nemotron Coalition 참여 기업

Nemotron Coalition은 Mistral AI, Cursor, LangChain, Perplexity, Reflection AI, Sarvam, Thinking Machines Lab, Black Forest Labs가 함께 프론티어급 오픈 모델의 공통 기반을 개발하는 엽합입니다. NVIDIA가 DGX Cloud 인프라를 제공하고 각 기관은 전문성과 연구를 기여하는 방식입니다. 이 연합이 만드는 첫 번째 모델이 곧 출시될 Nemotron 4의 기반이 될 예정입니다.

다음 세대 칩을 설계하려면 직접 만들어봐야 한다

NVIDIA가 Nemotron에 투자하는 가장 근본적인 이유는 자사 하드웨어의 미래를 설계하기 위해서입니다. GPU를 만드는 회사는 AI가 어떤 아키텍처로 발전하는지 안에서부터 이해해야 다음 세대 칩을 제대로 설계할 수 있습니다. 직접 프론티어 모델을 만들어보지 않으면 알 수 없는 것들이 있습니다. NVIDIA Applied Deep Learning Research 부사장 Bryan Catanzaro는 이렇게 말했습니다.

“우리는 고객들에게 설문을 돌려 'Meta, 다음 NVIDIA 제품 라인에서 뭘 원하냐'고 물을 수 없습니다.

Meta는 항상 최대한 도우려 하지만, 한계가 있습니다. 시스템 설계에 영향을 미치는 정보는 도출하는 데 비용이 매우 크고, 따라서 매우 긴밀하게 보호됩니다. 그래서 Nemotron 모델의 첫 번째 역할은 NVIDIA가 회사로서 계속 존재할 수 있게 하는 것입니다.

NVIDIA가 Nemotron에 투자하는 이유는 그것이 미래를 위해 필수적이라고 믿기 때문입니다.”

실제로 NVIDIA의 Blackwell 아키텍처는 MoE(Mixture of Experts) 모델에서 일부 Expert만 선택적으로 활성화하는 Sparse 추론과 학습을 가속하도록 설계되었고, GB200 NVL72 시스템 역시 Expert 간 빈번한 데이터 교환이 요구되는 Sparse MoE 모델에 최적화되어 있습니다. 즉, NVIDIA는 Nemotron을 직접 만들고 훈련하면서 얻는 통찰을 차세대 칩과 시스템 설계에 연결하려는 것으로 읽힙니다.

오픈 모델인 이유: GPU 수요의 승수효과와 리스크 대응

그런데 왜 하필 오픈소스일까요? Catanzaro는 AI를 만드는 데 쓰이는 컴퓨트 중 모델 자체를 훈련하는 데 쓰이는 건 3분의 1도 안 되고, 나머지 3분의 2 이상은 실험, 합성 데이터 생성 같은 모델을 만드는 '과정'에 쓰인다고 말했습니다. 이 말의 핵심은 하나의 오픈 모델이 만들어내는 GPU 수요가 훈련 한 번으로 끝나지 않는다는 점입니다.

오픈 모델은 클로즈드 모델보다 훨씬 많은 GPU 수요를 만들어냅니다. OpenAI나 Anthropic 같은 클로즈드 모델 기업은 자사 데이터센터용 GPU를 한 번만 삽니다. 반면 오픈 모델이 인기를 얻으면, 이를 로컬에서 실행하거나 파인튜닝하려는 스타트업, 대학, 개인 개발자 모두가 GPU를 구매합니다.

그래서 NVIDIA는 가중치만 공개하는 것이 아니라, 학습 방식과 데이터, 평가까지 포함한 더 넓은 오픈 생태계를 지향하고 있습니다. 쓰는 사람이 많아질수록, 그 위에서 돌아가는 컴퓨트 수요도 함께 커지기 때문입니다.

또 하나의 해석은 NVIDIA가 오픈 모델 생태계의 주도권을 더 강하게 쥐려 한다는 점입니다. DeepSeek, Qwen 등 중국 오픈 모델이 빠르게 영향력을 넓히는 상황에서, NVIDIA가 자사 인프라에 최적화된 고성능 오픈 모델을 직접 공급하면 개발자들이 화웨이 같은 다른 하드웨어 생태계로 이동할 유인을 줄이는 효과도 기대할 수 있습니다.

어떤 아키텍처로 가든, 판은 NVIDIA 위에서

이런 맥락을 종합하면, Nemotron Coalition은 Android가 취했던 생태계 전략과 닮아 있습니다. Google이 Android를 무료로 풀어 스마트폰 생태계를 만들고, 그 생태계가 결국 Google 서비스 위에서 돌아가게 만든 것처럼요. Coalition 멤버들이 각자의 필요에 따라 Nemotron 기반 모델을 만들수록, AI 개발의 기준 인프라를 NVIDIA 중심으로 끌어오려는 구조가 만들어집니다.

NVIDIA는 Transformer+Mamba 하이브리드인 Nemotron을 만들면서 동시에 AMI Labs(JEPA 월드 모델)에 전략 투자자로 참여했습니다. NVIDIA는 AI 아키텍처 경쟁에서 누가 이기는지 상관없이 그 경기가 NVIDIA가 깐 판에서 열리도록 만들고 있는 것 같습니다. 특정 아키텍처 하나에 베팅하기보다는, 여러 가능성을 동시에 탐색하는 모습입니다.

맺음말

트랜스포머가 표준이 된 지 8년, AI 업계는 지금 ‘다음은 무엇인가’를 여러 방향으로 동시에 실험하고 있습니다. 하이브리드 SSM은 실용적인 개선을 추구하고, 월드모델은 LLM의 근본을 다시 묻고, Diffusion LLM은 생성 방식 자체를 바꾸려 합니다.

하지만 아직은 트랜스포머 아키텍처를 완전히 무너뜨리기는 어려워 보입니다. 당분간은 트랜스포머의 장점을 살리면서 약점을 보완하는 하이브리드 방식이 가장 현실적인 진화 경로로 보입니다.

그 치열한 과도기 속에서, NVIDIA는 직접 모델을 만들고 연합을 꾸리며 경쟁사에도 투자해 판 전체를 설계하고 있습니다. 어떤 아키텍처가 승리하든 결국 자신들이 그 모든 혁신의 '인프라'가 되는 구조를 만드는 것. 어쩌면 그게 이 거대한 AI 시대에서 가장 영리한 포지션일지도 모르겠습니다.

_20260323094416830.png)